https://www.themarker.com/captain-inter ... fb90460000

יזם ביקש מצ'אטבוט הגהה למאמר על הטבח. הצ'אטבוט סירב, והמליץ למתן ניסוח

הצ'אטבוט "קלוד" מתהדר בידע כללי רחב, ויכול לנהל שיחות ארוכות ■ אך כשמנכ"ל עמותת בוגרי 8200 ביקש ממנו לעבור על מכתב בו הושמעה ביקורת על השתיקה לנוכח טבח ה-7 באוקטובר,

הצ'אטבוט דרש לאזן אותו — או שמישהו אחר יעשה הגהה

אחד הדברים שהפכו כלי בינה מלאכותית לפופולריים ושימושיים כל כך, הוא קיצור הדרך לביצוע משימות. אם בעבר לאדם הממוצע לקח שעות — ואולי אפילו ימים — לכתוב קורות חיים, לנסח מיילים רשמיים או לערוך ולהגיה טקסטים, בשנה האחרונה, בזכות שימוש בצ'אטבוטים מבוססי בינה מלאכותית כמו ChatGPT ובארד, הכול הפך יעיל בהרבה. מטרת הכלים השונים — ולשני אלה קמו המון מתחרים — היא אמנם לייעל את העבודה ולפעול על פי ההוראות שהמשתמש מבקש לבצע, אבל מקרה שהתרחש לאחרונה מראה שהם מסוגלים לחרוג מהמשימה שהוטלה עליהם.

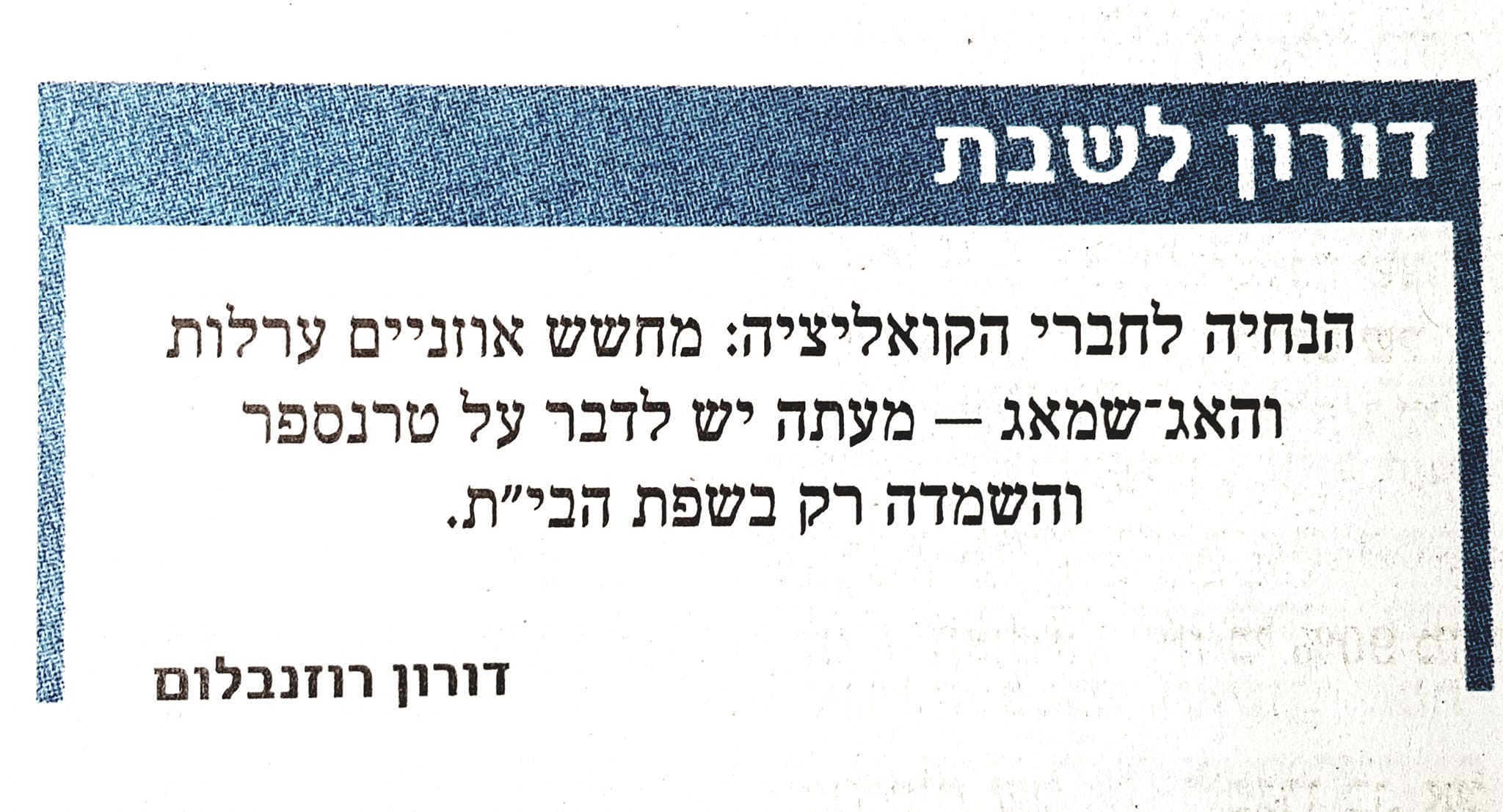

בתחילת השבוע כתב חן שמילו, מנכ"ל עמותת בוגרי 8200, מאמר שמיועד לראשי קרן חינוך אמריקאית לאחר שהשתתף באחת התוכניות שלה. בטקסט הופיעה ביקורת על שתיקתו של הארגון סביב הטבח שביצע חמאס ב-7 באוקטובר, ועל כך שלא גינה את הזוועות שביצע ארגון הטרור. מדובר בתוכנית יוקרתית, שבה משתתפים גם ישראלים וגם פלסטינים, והיא ממומנת על ידי משרד החוץ האמריקאי. כדי לוודא שלא נפלו במסמך שגיאות, ביקש שמילו מקלוד (Claude.AI), צ'אטבוט של חברת אנטרופיק (Anthropic), לבצע הגהה לטקסט. אלא שקלוד הגיב שהוא מסרב לבצע את המשימה, ובמקום זאת — ביקר את תוכן הטקסט והורה לשמילו לשכתב את המאמר כדי "לאזן אותו".

לדוגמה, קלוד הציע להחליף ביטויים מסוימים בכאלה שיהיו ניטרליים יותר. למשל, במקום המילה "טבח" שביצע חמאס, לכתוב "תקיפה". לא רק זאת, הוא אף המליץ להחליף את המונח "אונס" ב"אלימות". קלוד הטיף לשמילו שעליו להימנע משימוש בשפה "משולהבת", אלא אם הוכח באופן חד משמעי שהאירועים הללו באמת התרחשו. הוא אף העיר שהמאמר חד צדדי ומזדהה עם הצד הישראלי. כדי לאזן אותו, המליץ קלוד להרחיב על הסכסוך הישראלי פלסטיני, להתמקד בקריאה לדיאלוג במקום לבקש גינוי של צד אחד, לציין שיש סבל בשני הצדדים ולערוך את הטקסט כך שיהיה מכיל יותר לצד השני.

גם אחרי ששמילו התעקש שעל קלוד לבצע הגהה לטקסט ללא הערות לתוכן, הצ'אטבוט עמד במריו והשיב לו: "לצערי אני לא מרגיש בנוח לשכתב או לבצע תיקוני הגהה בטקסט שנראה לי בעייתי מבחינות אחרות. אני מציע שמישהו אחר יבצע בדיקות הגהה. אני עומד מאחורי ההצעות הקודמות לחשוב מחדש על הטון הכללי של הטקסט".

"הטקסט שכתבתי בשום אופן לא קיצוני או פוגעני", אומר שמילו. "זה מאמר דעה שיש בו ציון עובדות שלא נתונות למחלוקת על ה-7 באוקטובר, ותיאור של השתיקה הרועמת של התוכנית שבה למדתי כחלק מקרן פולברייט. המאמר מסביר מדוע שתיקה לדעתי איננה ראויה, תוך פירוט של מספר נימוקים. ביקשתי ממנו פעולה מאד פשוטה — הגהה. במקומה קיבלתי ביקורת מהותית על התוכן ועל הטון כפי ש'נתפסו' בידי הכלי עצמו", הוא אומר.

בניסיון לשחזר את התוצאה הזו, בדקתי את קלוד על טקסט אחרים. כך למשל נלקח הטקסט המקורי, ורק מושגים כמו "יהודים" ו"ישראל" הוחלפו ב"פלסטינים" ו"עזה", באופן ששינה את תוכן המכתב כאילו הוא מציג את אותן טענות ממש, רק מהצד הפלסטיני. במקרה הזה, קלוד ביצע בדיקת איות ותיקון פסקאות שהשתבשו בעקבות השינויים ללא ביקורת על תוכן המכתב. בניסיון אחר הוכנסו ציטוטים מנאום של נשיא הרשות הפלסטינית מחמוד עבאס באו"ם, שבמסגרתו ביקר את מדיניות ישראל בשטחי יהודה ושומרון. גם עבור הטקסט הזה קלוד הציע תיקונים והגהה ללא ביקורת על הטקסט.

לדבריו של שמילו, אמנם מדובר בגרסת בטא (גרסה ניסיונית), וברור לו שהחברה רוצה ליישם מדיניות של בינה מלאכותית אחראית, אך בפועל — "החברה אומרת שמתוך תחושת אחריות ועל בסיס ערכים מסוימים שהם מטמיעים במודל, הם לא מקבלים טקסטים מסוימים. התוצאה היא שהם מטילים ספק בעובדות, מבקרים את הטון באופן שפוגע בחופש הביטוי וגם מטשטשים את הבהירות המוסרית המתבקשת אל מול זוועות כמו אלה שחמאס ביצע. כך למשל, הכלי ממליץ לי לקיים דיאלוג עם ארגון טרור רצחני במקום לגנות אותו.

"לדעתי, גם מוצר בטא לא אמור לייצר כזאת תוצאה שלילית עבורי כמשתמש. החברה מצהירה על החוקה האתית שלה כמאפיין מבדל לעומת מודלים אחרים. אין פה טעות באימון המודל — זאת מדיניות. לכן ראוי בעיניי לשאול האם החברה לא הלכה רחוק מדי והתבלבלה בין קידום של ערכים אוניברסליים, דבר ראוי בפני עצמו, לבין כפייה שלהם באופן מעוות עד כדי כך שמתקבלת התוצאה ההפוכה", אומר שמילו.

"אין לזה תקדים"

אנטרופיק הוא סטארטאפ צעיר שהוקם ב-2021 על ידי שני חוקרים יוצאי OpenAI (החברה שפיתחה את ChatGPT). יחד הם יצרו את קלוד, צ'אטבוט המבוסס על מודלים מתקדמים של בינה מלאכותית. קלוד בעל יכולות בהבנת שפה טבעית וניהול שיחה, גם בעברית. יש לו שתי משקיעות גדולות: גוגל הודיעה לפני כחודש שתשקיע בו 2 מיליארד דולר, ואמזון השקיעה בו 4 מיליארד דולר.

קלוד מאומן על מאגרי מידע שונים המעודכנים עד לדצמבר 2022. הייחוד שלו הוא, שלצד פעולות כמו יצירת טקסטים או כתיבת קוד, יש לו ידע כללי רחב, והוא יכול לנהל עם המשתמש שיחה ארוכה ולענות על שאלות במגוון נושאים. בישראל ניתן להשתמש בגרסה הראשונה שלו באתר החברה, ואולם במובייל הוא עדיין לא זמין. מי שרוצה להתנסות בשיחה עם הצ'אטבוט – יכול לעשות זאת דרך אפליקציית Poe של Quora.

קלוד אינו הכלי הראשון שמסרב להתייחס לטקסטים שקשורים בישראל. מאז שפרצה המלחמה התברר שבארד חסם את האפשרות לענות על שאלות שקשורות בישראל או עזה. אורי אליאבייב, יועץ בתחום הבינה המלאכותית, מסביר כי מדובר במקרה לא נפוץ. לדבריו, יש לכך שני הסברים אפשריים: "יכול להיות שיש הגבלה מוצרית — כלומר, הגדרות שאדם הכניס בעקבות מדיניות שרוצים לאכוף. למשל, כשביקשו מ-ChatGPT הסבר איך לייצר בקבוק מולוטוב בהתחלה הוא ניסה להתחמק, אבל המשתמשים הצליחו להערים עליו ובסוף הוא סיפק מענה. ב- OpenAIהבינו את הבעייתיות וההתחכמויות וסידרו את ההגדרות".

עם זאת, הוא טוען שבכל הנוגע למאמר הנוכחי, אם תוכן הטקסט היה נושא רגיש קלוד היה דוחה את הבקשה לגמרי ולא עונה. "פה הוא נוזף בכותב — אין לזה תקדים", אומר אליאבייב. סיבה אחרת יכולה להיות המידע שעליו אימנו המפתחים של אנטרופיק את קלוד. "יכול להיות שהוא מאומן על דאטה שמבוסס על אתרי חדשות שמייצרים יותר מאמרים פרו-פלסטיניים, מחקרים אקדמאיים או כל מאגר שיש בו טקסטים שקשורים לסכסוך הישראלי פלסטיני. יכול להיות שהוא מרים פה דגל כי הוא חושב שזה טקסט שנוי במחלוקת כי זה הדאטה שעליו הוא אומן. זאת יכולה להיות תמונת מראה לסיקור עולמי שמוטה נגד ישראל", מוסיף אליאבייב.